L’avenir de l’intelligence artificielle générative sera-t-il open source ? Deux visions cohabitent au sein de la Silicon Valley.

Il y a d’un côté des groupes comme OpenAI et Google qui développent des modèles propriétaires, et de l’autre des entreprises comme Meta qui, pour l’instant, préfèrent opter pour des solutions ouvertes. En France, Mistral et Kyutai misent aussi beaucoup sur l’ouverture, même si le dernier modèle de Mistral n’est pas totalement open source, la faute à des ambitions relevées qui ont une incidence sur la stratégie de la startup.

Et Apple dans tout ça ? Le géant californien, dont l’entrée sur le secteur de l’IA générative se fait attendre (il devrait dévoiler sa stratégie le 10 juin, avec iOS 18), est un habitué de la fermeture et du secret.

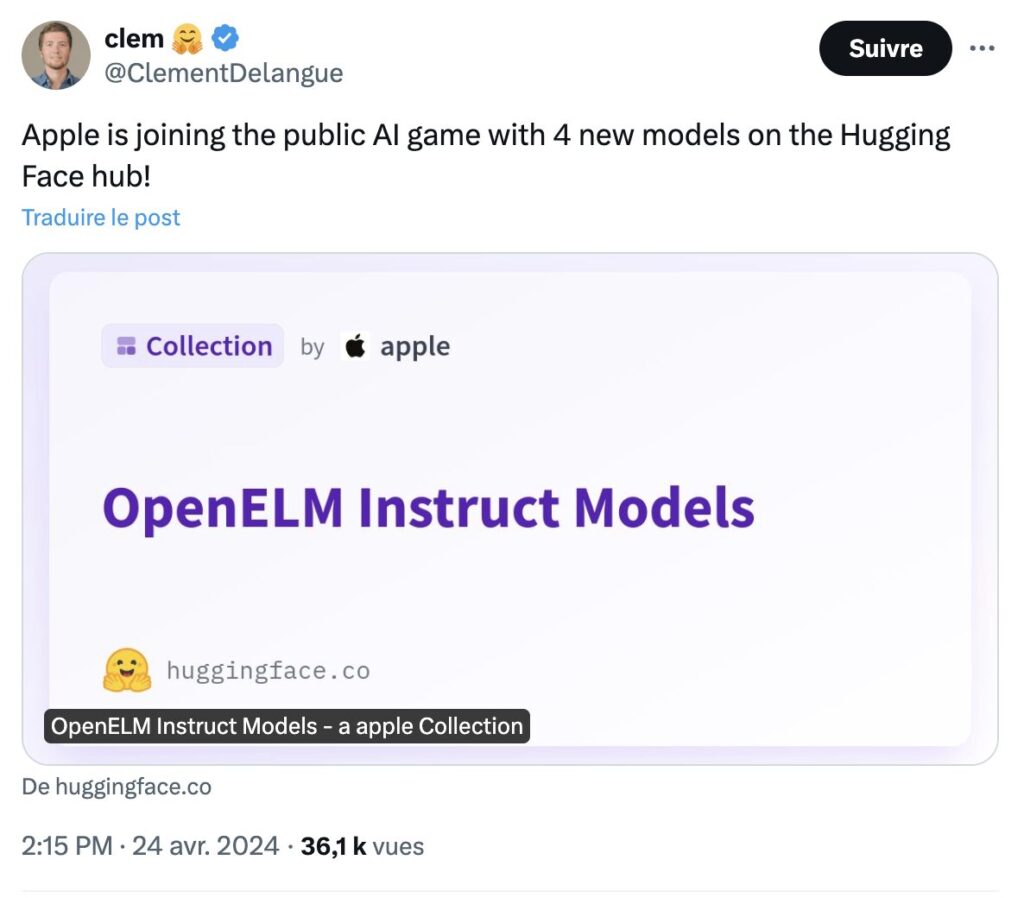

Pourtant, et à la surprise générale, la marque vient de publier dans la bibliothèque HuggingFace quatre versions d’un modèle de langage inconnu, baptisé OpenELM. Il s’agit d’un grand modèle de langage (LLM, pour large language model) open source, dont une partie du code est aussi disponible sur GitHub.

Apple et l’IA : une approche open source inévitable ?

Apple n’est pas réticente à l’open source puisqu’elle publie régulièrement les codes sources de ses anciens systèmes d’exploitation sur une page dédiée. WebKit (le moteur de Safari), Swift (son langage de programmation) et ResearchKit (une API pour la recherche médicale) sont aussi accessibles librement.

Sur le secteur de l’IA générative, Apple a publié plusieurs travaux ces derniers mois, souvent sur Github. Ferret, Llarp, Mgie… Ces modèles se destinent aux chercheurs et visent à prouver qu’Apple n’est pas complètement distancé par la concurrence, puisqu’elle entraîne aussi des machines à reconnaître des images et à générer du texte. Reste à savoir comment ces modèles seront utilisés dans iOS et macOS.

Avec OpenELM, Apple donne sans doute un premier aperçu de ce qui va arriver dans ses futurs systèmes d’exploitation. Décliné en 4 configurations (270 millions de paramètres, 450 millions, 1 milliard et 3 milliards), OpenELM est un « petit » grand modèle de langage. Les 70 milliards de paramètres de LLaMA-3, en attendant la version du modèle avec 400 milliards de paramètres, ridiculisent le modèle d’Apple. Il est facile de deviner où Apple se dirige : OpenELM va tourner en local, sans besoin de se connecter aux serveurs d’Apple.

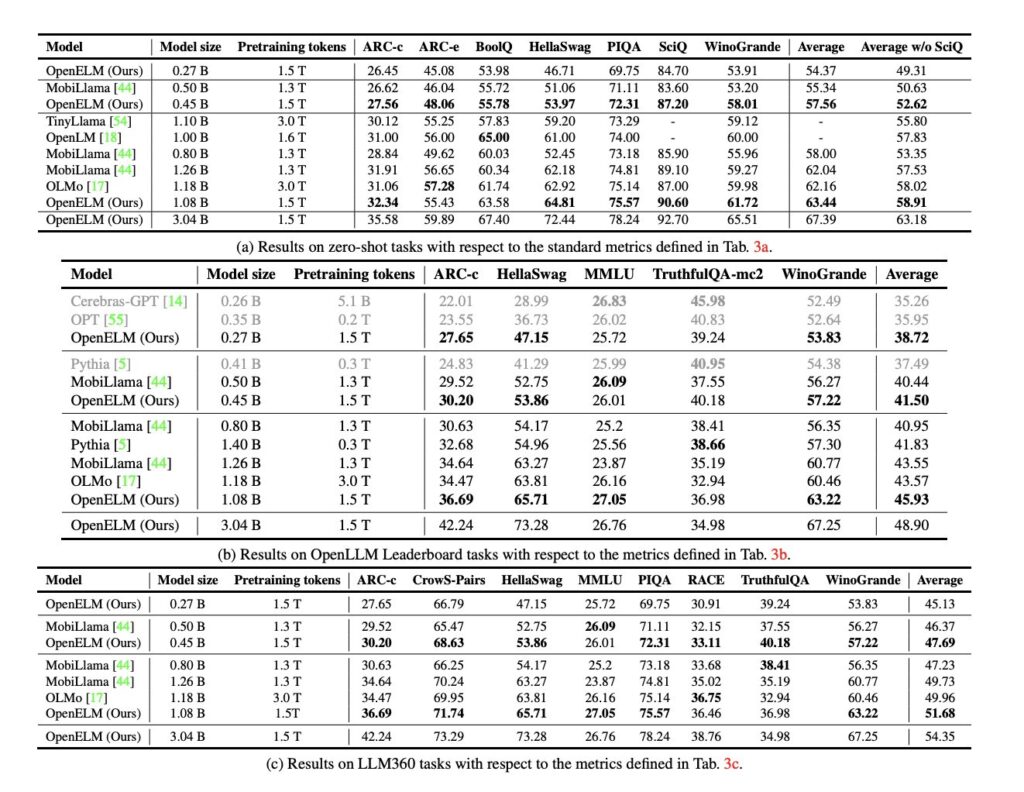

« Nous publions OpenELM, un modèle de langage ouvert de pointe. OpenELM utilise une stratégie de mise à l’échelle par couches pour allouer efficacement les paramètres dans chaque couche du modèle de transformateur, ce qui permet d’améliorer sa précision », détaille Apple dans un rapport de recherche.

« OpenELM surpasse les LLM existants de taille comparable formés sur des ensembles de données accessibles au public ». Le géant de l’électronique grand public indique que son modèle a besoin de deux fois moins de tokens de pré-entraînement pour surpasser la concurrence.

Avec cette approche plus ouverte, Apple espère sans doute agréger la communauté de l’IA autour d’OpenELM, et qu’elle contribue à l’améliorer. La marque a aussi publié Corenet, une bibliothèque d’entraînement utilisée par ses modèles de langage, ouverts et fermés.

OpenELM a toutes ses chances d’intégrer l’iPhone avec iOS 18, si Apple le juge suffisamment performant pour prendre son envol.

Abonnez-vous à Numerama sur Google News pour ne manquer aucune info !