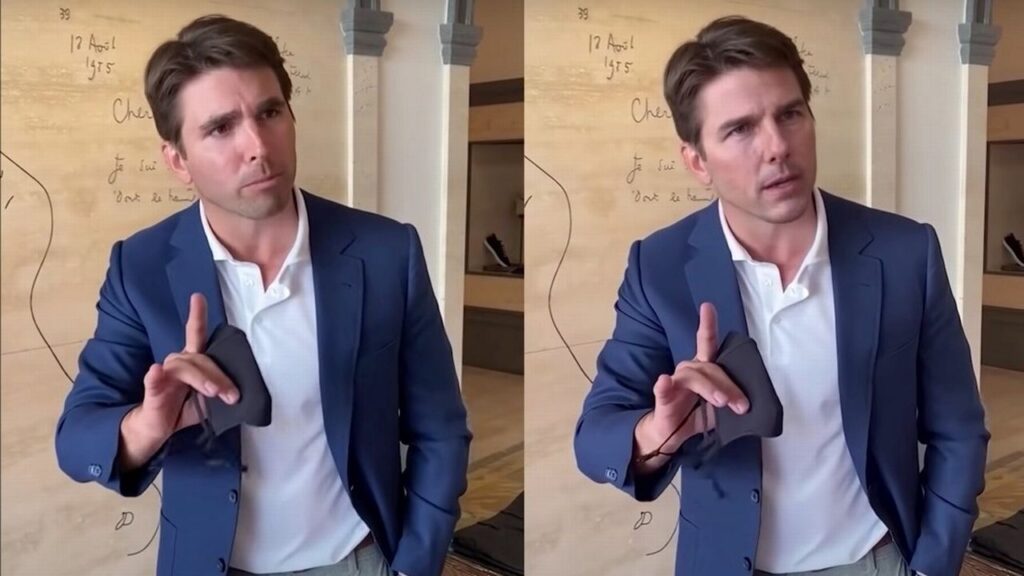

Dès la diffusion des premières vidéos de deepfakes sur YouTube, on se doutait bien cette technologie serait à un moment ou un autre utilisée par des escrocs. Le FBI a confirmé ces craintes, ce mardi 28 juin 2022, dans un communiqué où il appelle à être vigilant face à un nombre croissant d’usurpations de visage. Des malfaiteurs se font passer pour d’autres personnes, lors d’entretiens en visio pour des emplois dans le secteur de la technologie impliquant l’accès à des informations sensibles.

Pour aller jusqu’au bout de l’arnaque, les escrocs auraient également copié la voix d’autres individus, mais c’est ce détail qui leur a fait défaut. « Durant ces entretiens, les actions et le mouvement des lèvres de la personne que l’on voit interrogée ne se coordonnent pas complètement avec l’audio de la personne qui parle. Parfois, des actions telles que la toux, les éternuements ou d’autres actions auditives ne correspondent pas à ce qui est présenté visuellement », a déclaré le FBI.

La police fédérale américaine indique que l’arnaque a été tentée pour des emplois de développeurs dans la data et les fonctions liées à des logiciels précis. Certains des postes ciblés ouvraient l’accès aux informations personnelles des clients, à des données financières et à des informations exclusives. Les victimes dont les données ont été volées ont déclaré que leur identité avait été utilisée pour des vérifications d’antécédents avant l’embauche pour d’autres postes.

L’urgence d’un outil de détection

Les deepfakes – l’apprentissage profond – utilisent l’intelligence artificielle pour analyser les détails de notre visage et les retranscrire à l’identique. Néanmoins, si on peut créer un double parfait en apparence, les expressions, les mouvements des yeux trahissent souvent cette technologie, et les humains sont extrêmement doués pour repérer de telles incohérences.

On ne connaît pas l’objectif réel des malfaiteurs, mais le motif est clair, se faire embaucher. Ce qui est plus inquiétant est qu’ils sont parvenus à réaliser un deepfake à partir d’informations et d’images dérobées ou trouvées en open source. Cela laisse présager que l’identité de n’importe qui est susceptible de se faire usurper après une fuite de base de données, et on en signale des nouvelles chaque mois. Facebook a développé sur un outil de détection des deepfakes, mais cette histoire prouve que des logiciels doivent être urgemment mis à disposition des professionnels.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Marre des réseaux sociaux ? Rejoignez la communauté Numerama sur WhatsApp !