Un groupe lié au renseignement russe serait chargé de produire de fausses informations à partir d’outils basés sur l’intelligence artificielle (IA). Dans un rapport publié le 24 juin par la société de cybersécurité The Record, des chercheurs ont mis en évidence plusieurs exemples de campagnes de désinformation générées par IA et propulsées par une entité baptisée CopyCop.

Selon The Record, l’IA est utilisée pour générer des articles et des profils de journalistes. Les chercheurs ont trouvé plus de 1 000 profils d’auteurs distincts sur 120 nouveaux sites créés par CopyCop en mai.

Ces faux médias plagient des articles de nombreux titres légitimes et les détournent pour fustiger Joe Biden, l’Ukraine, les politiques dans les pays occidentaux. L’audience directe de ces contenus générés par IA est très faible, voire nulle, mais l’essentiel réside dans « l’amplification de ces infos par de comptes tenus par des personnes réelles sur les réseaux sociaux », constate les chercheurs.

Des indices pour repérer une manipulation par l’IA

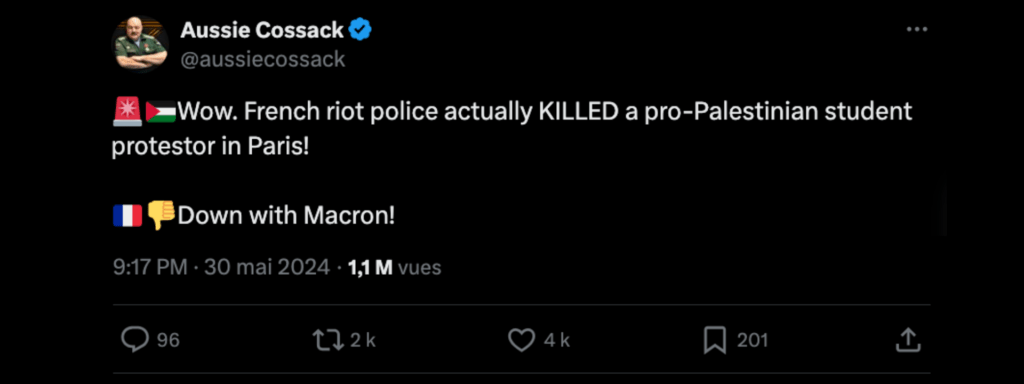

The Record prend l’exemple d’une fausse information générée par IA ciblant la France qui a rapidement été reprise par de nombreux comptes authentiques. En mai dernier, la vidéo d’un jeune algérien commence à tourner sur X (ex Twitter) qui dénonce le meurtre de son frère, un militant pro-Palestine, tué par la police. L’info est reprise par de nombreux comptes pro-russe suivi par des milliers d’abonnés.

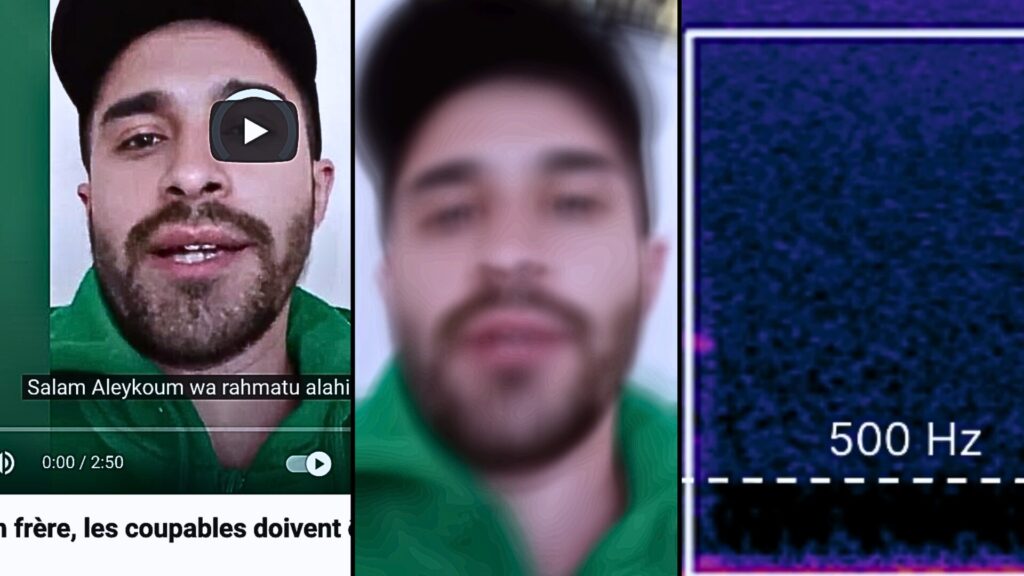

En analysant les images et le son de la vidéo, les chercheurs de The Record indiquent que des outils d’intelligence artificielle ont permis de détourner la vidéo.

« Premièrement, l’homme représenté dans la vidéo cligne des yeux trois fois sur une période de près de deux minutes et cinquante secondes — les humains clignent des yeux en moyenne douze fois par minute. De plus, l’homme reste dans une position fixe pendant trois minutes, ce qui pourrait indiquer un contenu visuel généré par IA », peut-on lire dans le rapport.

L’entreprise a également analysé l’audio du faux témoignage. Les experts trouvent des coupures précises entre les phrases indiquant que des espaces ont été ajoutés pour rendre le discours plus naturel. « Ces espaces vides dans le spectrogramme démontrent qu’une couche de bruit blanc a été ajoutée précisément au-dessus de 500 Hz » notent les chercheurs.

The Record prédit des opérations similaires et potentiellement plus nombreuses cet automne, durant les élections américaines.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Marre des réseaux sociaux ? Rejoignez la communauté Numerama sur WhatsApp !