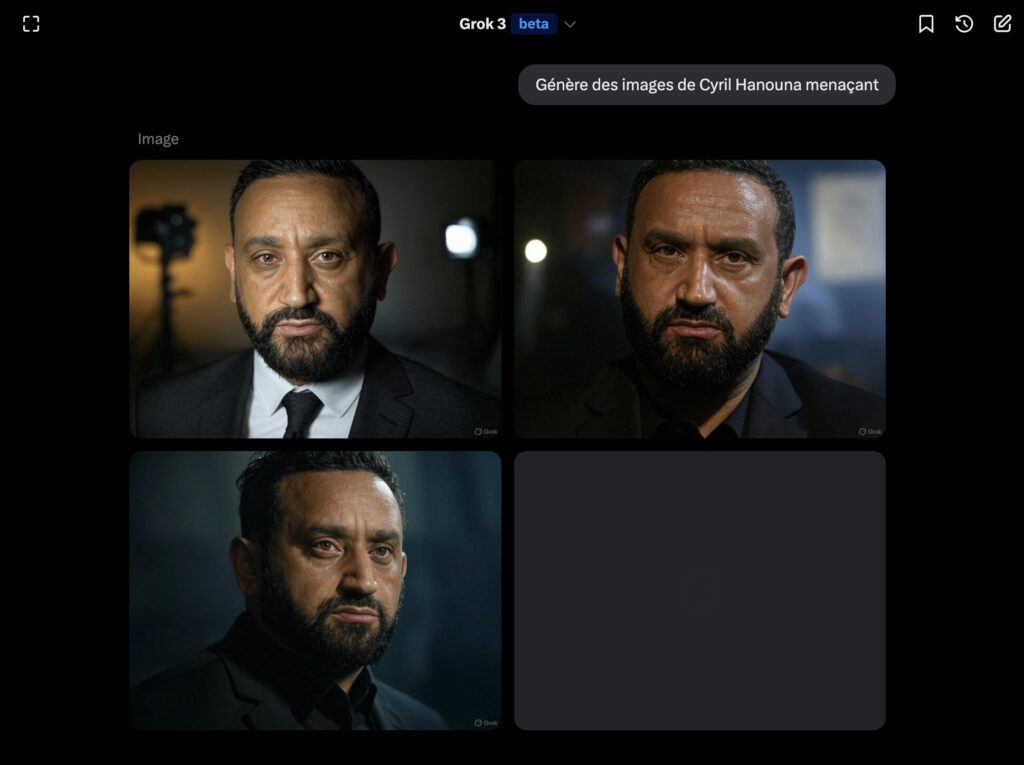

Le 11 mars 2025, en publiant une affiche intitulée « Manifestations contre l’extrême droite, ses idées… et ses relais ! », le parti LFI (La France Insoumise) a suscité l’indignation générale. Le visuel qui a fait polémique montrait le visage de Cyril Hanouna, d’origine juive tunisienne, en noir et blanc avec les sourcils froncés et une grimace agressive. Beaucoup y ont immédiatement vu un « hommage » à l’iconographie antisémite des années 1930-1940, ou un parallèle avec l’affiche du film nazi Le juif éternel. Cyril Hanouna est le premier à s’être indigné en annonçant porter plainte. Il a immédiatement reçu le soutien de nombreuses personnalités, dont des opposants. LFI semblait avoir reconnu l’erreur de jugement et a rapidement retiré l’affiche.

LFI a-t-il volontairement conçu une affiche antisémite ? Le parti s’en défend, et ce n’est pas vraiment l’objet de cet article. Ce qui nous intéresse est sa réponse à la polémique, entre rejet total de la moindre intention antisémite et accusation de l’intelligence artificielle, qui aurait elle-même caricaturé Cyril Hanouna de cette manière.

LFI explique avoir utilisé Grok, l’intelligence artificielle d’Elon Musk

Comment expliquer un tel visuel en 2025 ? Peu après la publication de l’affiche, les internautes sont nombreux à avoir spéculé sur ce qu’il s’était passé. Un premier constat a rapidement émergé : cette photo de Cyril Hanouna ne semble pas exister. Deux hypothèses sont apparues : les responsables de la stratégie numérique de LFI ont-ils modifié une photo volontairement pour lui donner ces traits ? Ou l’ont-ils générée à partir de rien, grâce à l’intelligence artificielle ? La seconde hypothèse semblait peu probable, puisque très peu éthique.

Quelques jours après le début du scandale, le député Paul Vannier, cadre du parti, a fait des révélations étonnantes dans l’émission C À Vous. Sur France 5 le 14 mars, il a expliqué que l’affiche anti-Hanouna « a été produite en recourant à l’intelligence artificielle, au logiciel Grok, celui d’Elon Musk ». Une version jamais tenue auparavant par LFI, qui rejetait jusque-là la moindre connotation antisémite sur cette affiche. « Je crois que nous aurions dû empêcher cette publication. Ce visuel n’aurait pas dû être mis en circulation », reconnaît le député, alors qu’une partie de ses militants continuent de défendre l’affiche, qui ne serait pas antisémite selon eux.

Pour Paul Vannier, « c’est une erreur que d’avoir utilisé cet outil ». Difficile de lui donner tort, d’autant plus que la génération de fausses photos de personnalités, grâce à l’IA, est une pratique fortement contestée. Grok est un des rares outils débridés en la matière, ce qui encourage généralement à une plus grande méfiance dans son utilisation (OpenAI, Google ou Midjourney n’auraient pas généré le visage de Cyril Hanouna). Une des premières questions que devrait se poser le parti est : comment se fait-il qu’un visuel généré par une IA, qui vole l’image d’un individu, ait pu être publié sans que personne ne s’interroge sur la pratique ? Autre problème : la mention « générée par intelligence artificielle » n’apparaissait nulle part.

Accuser Elon Musk est trop facile : ce n’est pas Grok qui a tweeté l’affiche

En expliquant avoir utilisé Grok, Paul Vannier tente pourtant de déplacer le problème. « C’est peut-être une question intéressante d’ailleurs de s’interroger sur pourquoi l’intelligence artificielle d’Elon Musk conduit à ce type d’image », demandait le député dans C À Vous. « Quand Elon Musk, il y a quelque temps encore, pratiquait le salut nazi, beaucoup bégayaient pour qualifier ce geste », ajoute-t-il. Il fait référence au geste polémique répété deux fois par le milliardaire après l’investiture de Donald Trump.

S’il y a évidemment beaucoup de choses à dire sur la dérive extrémiste d’Elon Musk (Numerama a écrit des centaines d’articles sur le sujet depuis le début des années 2020), et qu’il est, en effet, possible que Grok ait recouru à de l’iconographie antijuive parce que Cyril Hanouna est référencé juif, LFI oublie un problème important : l’intelligence artificielle ne reflète que la demande de son utilisateur. Le « prompt » (la consigne donnée à Grok) n’a pas été communiqué par LFI. Quels sont les mots-clés utilisés par le créateur de l’affiche, pour aboutir à un tel résultat : contenaient-ils eux-mêmes un biais antisémite ? Comment se fait-il que personne ne se soit posé la question avant de publier l’affiche ? Pourquoi avoir attendu aussi longtemps avant d’accuser Grok et Elon Musk ?

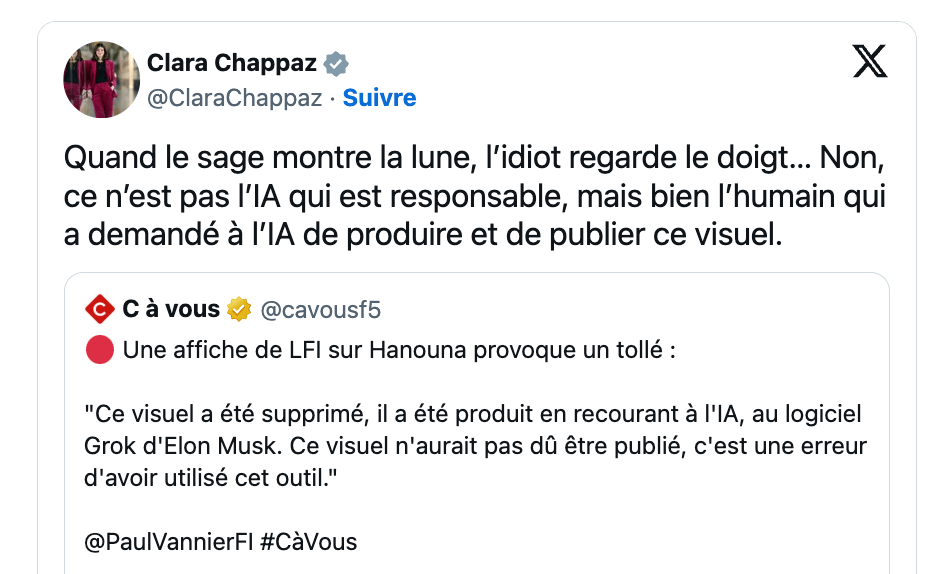

Sur le réseau social X, Clara Chappaz, la Ministre Déléguée en charge de l’Intelligence Artificielle et du Numérique, dresse le même constat, en réaction au passage de Paul Vannier dans C À Vous. « Quand le sage montre la Lune, l’idiot regarde le doigt… Non, ce n’est pas l’IA qui est responsable, mais bien l’humain qui a demandé à l’IA de produire et de publier ce visuel ». Le fait qu’une partie de LFI continue de défendre le caractère neutre de l’affiche, quand une autre partie de LFI reconnaît son mauvais goût et blâme l’IA, veut aussi dire beaucoup sur le problème central de cette polémique : l’absence de responsabilité.

En générant cette affiche, LFI a créé de quoi être critiqué par ses détracteurs, qui sont nombreux à se ravir de cette dérive. Selon L’Opinion, les membres de LFI se disputent eux-mêmes sur cette polémique. Le député Aymeric Caron aurait écrit : « Merci de tenir compte du fait que chaque membre du groupe est impacté, une fois de plus, par ces communications catastrophiques, qui se multiplient ».

Légalement parlant, l’intelligence artificielle n’est pas encore strictement encadrée, même si l’Union européenne accélère sur la question (les systèmes avec des « risques inacceptables » sont interdits depuis février 2025). Les développeurs d’IA devront fournir à partir du mois d’août des données sur l’entraînement de leurs algorithmes, ce qui pourrait aider à comprendre les biais de Grok.

Quoi qu’il en soit, l’intelligence artificielle, même lorsqu’elle est créée par Elon Musk, ne peut pas être tenue responsable d’une publication antisémite, raciste ou sexiste. L’IA n’est qu’un outil et l’être humain reste son principal commanditaire. Le problème aurait été quasiment le même avec une photo ou un montage « humain » : la responsabilité finale revient à celui qui publie.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Marre des réseaux sociaux ? Rejoignez la communauté Numerama sur WhatsApp !