[Les systèmes d’intelligence artificielle sont des systèmes informatiques qui sont le plus souvent dotés de la possibilité d’évoluer, de s’adapter et de s’automodifier. Leurs concepteurs cherchent à les rendre aussi autonomes que possible et ils en viennent souvent à se demander dans quelle mesure de tels systèmes pourraient acquérir la notion du temps.

Le problème central est celui de l’interprétation des données que l’on fournit à une machine pour qu’elle apprenne : les données de l’expérience ont besoin du temps pour être interprétées et, réciproquement, le temps a besoin de l’expérience pour prendre sa consistance et permettre l’interprétation des données. Il y a donc une intrication. On peut bien sûr apprendre à une machine toute sorte de choses, comme distinguer des tumeurs bénignes de tumeurs malignes sur des photos médicales, mais comment un robot pourrait-il se construire une notion de « temps », avec toute la richesse que ce mot représente ? Par exemple, dans le contexte d’une interaction avec des êtres humains, comment faire en sorte qu’un robot sache de lui-même s’il n’est pas trop rapide ou trop lent ? Comment parviendrait-il à se rendre compte que quelque chose a brusquement changé dans le comportement de son interlocuteur ?

Le temps informatique mesuré comme un nombre d’étapes

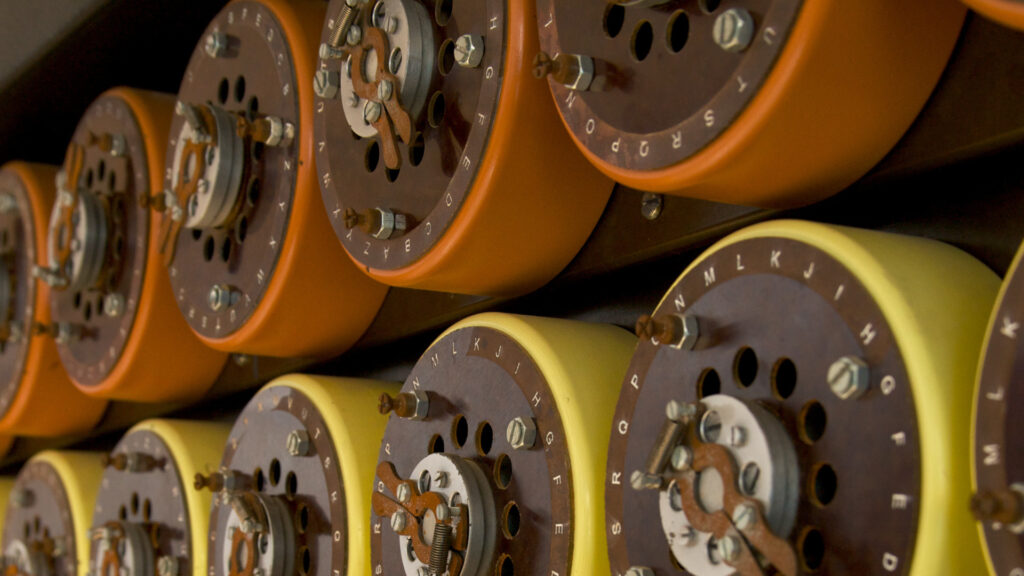

À ce jour, l’ensemble des systèmes informatiques fonctionne sur les bases algorithmiques posées par Alan Turing en 1936. Alan Turing partit de l’hypothèse que toute méthode systématique de résolution d’un problème, c’est-à-dire tout algorithme, peut être traduite dans un langage qui s’adresse à une machine élémentaire réalisant des opérations de lecture-écriture sur un ruban infini.

Les systèmes informatiques dont nous disposons n’opèrent pas exactement sur ce type de machine, mais on admet généralement un principe d’équivalence : tout ce qui peut être réalisé par une machine donnée peut également être réalisé par cette machine de Turing, dite « universelle ».

Ce point est particulièrement important pour comprendre les évolutions temporelles des systèmes d’intelligence artificielle. En effet, ceux-ci utilisent des calculs « parallèles » : au lieu de faire une opération après l’autre, ces systèmes peuvent, comme dans un cerveau, faire interagir des milliers de composants simultanément. On parle souvent à propos de telles architectures de « connexionnisme » : il ne s’agit pas seulement comme dans le cas du parallélisme classique de faire interagir plusieurs systèmes en même temps, mais de parvenir à coordonner une myriade d’unités de calcul, et ce sans unité centrale.

Dans ce contexte, le principe d’équivalence énoncé par Turing tient encore : une architecture en réseau peut accélérer les calculs, mais ne peut jamais permettre de faire ce qui est hors de portée pour une machine séquentielle. En ce qui concerne le temps d’exécution des algorithmes, cela signifie que si j’ai une machine avec des millions de neurones formels qui changent d’état en parallèle, j’aurais probablement la possibilité d’effectuer des algorithmes de manière plus rapide, mais le temps intrinsèque de la machine sera toujours donné par le temps des horloges des microprocesseurs qui cadencent cette machine. Il existe plusieurs dispositifs de calcul non classiques, tels que les ordinateurs quantiques ou les puces dites neuromorphiques : certes, leur programmation oblige à penser de façon différente et sont la source de nombreuses promesses pour repousser les frontières du calcul, cependant ils n’échappent nullement au principe d’équivalence de Turing et aux limites que cette équivalence impose.

Un système d’intelligence artificielle reste donc conditionné dans son rapport au temps par sa structure algorithmique discrète, laquelle décrit l’évolution des systèmes pas à pas. Le temps informatique est donc toujours mesuré comme un nombre d’étapes, que celles-ci soient parallèles ou séquentielles.

Du point de vue des robots, les humains sont des lourdauds

Il y a une inhomogénéité fondamentale entre le temps des êtres humains et celui des machines. Il faut garder à l’esprit que n’importe quel ordinateur, téléphone, ou même n’importe quelle puce qui se trouve dans une machine à laver effectue des milliards d’opérations par seconde. En d’autres termes, l’échelle avec laquelle les cadences des microprocesseurs sont mesurées est le gigahertz. Si l’on pouvait se placer du point de vue des robots, nous verrions les êtres humains comme des lourdauds qui pensent et se meuvent à une vitesse phénoménalement lente. On peut faire une analogie avec la manière dont les plantes évoluent pour nous. Les robots seraient donc amenés à se brider considérablement pour « s’abaisser » à notre rythme !

D’ailleurs, ces problèmes ont été perçus dès le début de la réflexion sur la question de l’intelligence artificielle. Alan Turing, par exemple, dans son article de 1950, demande à ce que la machine qui remplace un être humain jouant au jeu de l’imitation marque un temps d’arrêt artificiel avant de donner le résultat d’une multiplication, sans quoi elle serait immédiatement démasquée. De tels délais sont aujourd’hui utilisés pour rendre les conversations des « assistants vocaux » plus naturels.

La science-fiction a aussi souvent exploité le filon de l’incommensurabilité du temps humain et du temps des machines. Par exemple, dans le film Her de Spike Jonze (2013), le protagoniste est séduit par son système d’exploitation et finit par tomber amoureux d’« elle ». Néanmoins, au plus fort de leur liaison (platonique), elle lui avoue que, pendant la durée de leur conversation intime, elle a pu lire plusieurs milliers de livres et converser avec plusieurs centaines d’autres personnes.

Le roman d’Antoine Bello Ada met en scène une créature virtuelle chargée d’écrire des romans à l’eau de rose et un inspecteur qui cherche à la retrouver après qu’elle s’échappe de l’atelier de ses créateurs. Ada sait jouer avec les sentiments de l’inspecteur et elle a la fâcheuse tendance à effectuer des recherches sur des éléments de sa vie en même temps qu’ils discutent. Quant à sa collègue, Jessica, celle-ci est programmée pour écrire des biographies personnalisées avec la faculté de traiter des dizaines de milliers de clients en parallèle… L’imaginaire de l’intelligence artificielle nous rappelle que les créatures artificielles manquent cruellement d’un ici et d’un maintenant pour pouvoir être considérées pleinement comme autre chose que des objets.

Les chercheurs qui essaient de donner aux machines la possibilité d’interpréter le langage humain font aussi face à des défis colossaux. Saisir la temporalité reste ce qu’il y a de plus difficile. Une simple phrase comme « Maintenant, ça suffit ! », qu’un enfant comprend immédiatement, reste une énigme pour des systèmes informatiques, car que signifie ce « maintenant » ? Certainement pas la même chose que dans « Maintenant, il est temps de passer à table ». Chacun comprend que seule une expérience de la vie permet de saisir les nuances de la langue et que tout ne se ramène pas à des « faits » que l’on peut encoder dans des systèmes informatiques. En particulier, notre propre perception du temps qui passe s’inscrit dans une rythmicité journalière, qui s’inscrit dans une rythmicité plus longue (le mois, l’année, etc.), qui elle-même s’inscrit dans le chemin d’une vie, chemin qui prend son sens dans son inscription dans une histoire plus longue, voire dans un rapport à un temps non mesurable comme le montrent les mythes de toutes les civilisations.

Le véritable danger de l’intelligence artificielle, en voulant sans cesse tout accélérer, ne serait-il pas d’occulter cette dimension fondamentale de l’être humain à savoir, non pas seulement que les choses prennent du temps, mais aussi que la maturation de toute bonne chose demande un temps incompressible ? Les blés ont besoin de temps pour mûrir et le pain a besoin d’un temps pour cuire. Si un jour les robots comprennent cela, on pourra dire qu’ils seront devenus alors véritablement… « humains ».![]()

Nazim Fatès, Chargé de recherches, Inria

Cet article est republié à partir de The Conversation sous licence Creative Commons. Lire l’article original.

![]()

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Marre des réseaux sociaux ? Rejoignez la communauté Numerama sur WhatsApp !