C’est un énième fait divers lié à Tesla qui fait froid dans le dos : comme rapporté dans un article du New York Times le 18 avril, deux hommes ont perdu la vie à bord d’une Model S samedi soir, au Texas. Selon les premiers éléments de l’enquête, personne n’était derrière le volant au moment du crash. Tout porte à croire que les deux victimes ont voulu pousser un peu trop loin la technologie Autopilot, qui permet à la voiture de conduire seule dans des conditions très favorables.

L’agent Mark Herman a indiqué que l’un des hommes était assis à l’avant, mais côté passager, tandis que l’autre était installé à l’arrière. Si rien ne permet de confirmer que l’Autopilot était bien activé au moment des faits, le duo aurait discuté de la technologie avant de partir pour leur virée tragique. Hasard du calendrier : dans un tweet publié le même jour, Elon Musk vante l’efficacité de l’Autopilot d’après une nouvelle étude publiée par Tesla : quand elle est activée, la super assistance permettrait de réduire les risques d’accident (près de 10 fois moins de risque).

Encore une preuve que les Tesla ne sont pas des voitures autonomes

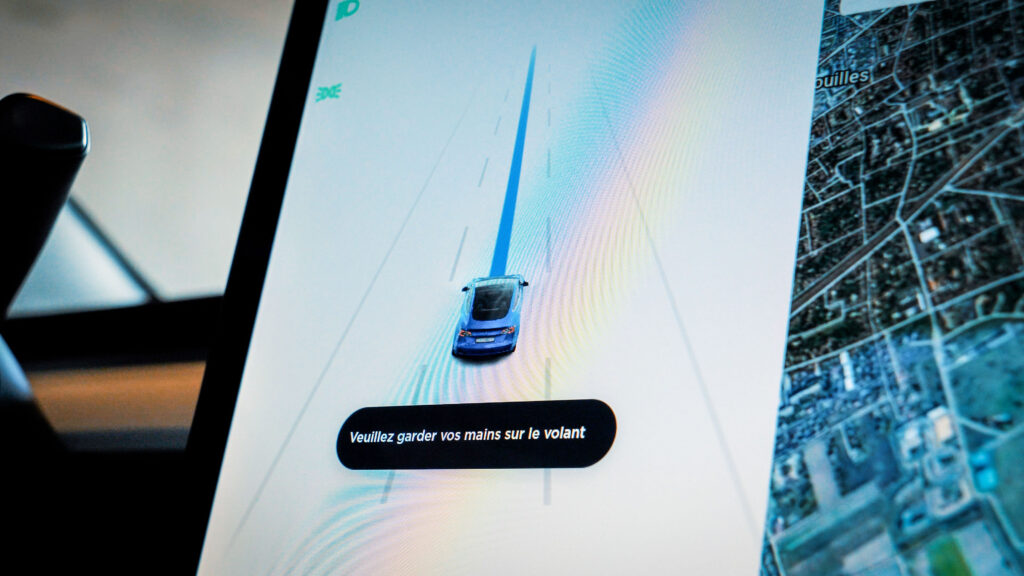

Les Tesla ne sont pas encore des voitures 100 % autonomes. Et cet accident, qui a hélas coûté la vie de deux hommes, en est une nouvelle preuve. La Tesla Model S, datant de 2019, a percuté un arbre à une vitesse très élevée après avoir loupé un virage dans un quartier résidentiel situé dans les Woodlands. La voiture a immédiatement pris feu et les pompiers ont mis du temps à l’éteindre. « Il a fallu quatre heures pour éteindre un feu qui, normalement, peut l’être en quelques minutes », a indiqué Mark Herman.

Plusieurs éléments tendent à prouver que les deux hommes aient pris des risques inconsidérés. Il y a d’abord la question du lieu : un quartier résidentiel a priori situé près d’une forêt ne paraît pas être l’endroit idéal pour tester l’Autopilot, aujourd’hui pensé pour offrir une conduite semi-autonome assez sûre, mais sur des voies rapides (plus simples à gérer pour une intelligence artificielle). Numerama a pu le vérifier lors d’un essai prolongé de la Model 3.

Il y a aussi cette hypothèse selon laquelle personne n’était derrière le volant au moment de l’accident. Tesla ne cesse pourtant de rappeler que l’Autopilot, s’il facilite grandement l’expérience de conduite, nécessite une vigilance constante — comme si on conduisait normalement. Sur le configurateur en ligne, il est stipulé : « Les fonctionnalités actuelles exigent une surveillance active de la part du conducteur et ne rendent pas le véhicule autonome. »

Si on peut accuser Tesla d’aller un peu trop loin dans le développement de technologies susceptibles de mettre en danger la vie des utilisateurs (et de semer la confusion dans les esprits), les propriétaires restent responsables de leur usage dans les conditions qui s’y prêtent. Par le passé, on a déjà vu des exemples montrant que les gens peuvent faire n’importe quoi avec l’Autopilot, fort heureusement avec des conséquences moins tragiques.

+ rapide, + pratique, + exclusif

Zéro publicité, fonctions avancées de lecture, articles résumés par l'I.A, contenus exclusifs et plus encore.

Découvrez les nombreux avantages de Numerama+.

Vous avez lu 0 articles sur Numerama ce mois-ci

Tout le monde n'a pas les moyens de payer pour l'information.

C'est pourquoi nous maintenons notre journalisme ouvert à tous.

Mais si vous le pouvez,

voici trois bonnes raisons de soutenir notre travail :

- 1 Numerama+ contribue à offrir une expérience gratuite à tous les lecteurs de Numerama.

- 2 Vous profiterez d'une lecture sans publicité, de nombreuses fonctions avancées de lecture et des contenus exclusifs.

- 3 Aider Numerama dans sa mission : comprendre le présent pour anticiper l'avenir.

Si vous croyez en un web gratuit et à une information de qualité accessible au plus grand nombre, rejoignez Numerama+.

Toute l'actu tech en un clin d'œil

Ajoutez Numerama à votre écran d'accueil et restez connectés au futur !

Marre des réseaux sociaux ? Rejoignez la communauté Numerama sur WhatsApp !